Dirección

175 Greenwich St, New York, NY 10007

Dirección

175 Greenwich St, New York, NY 10007

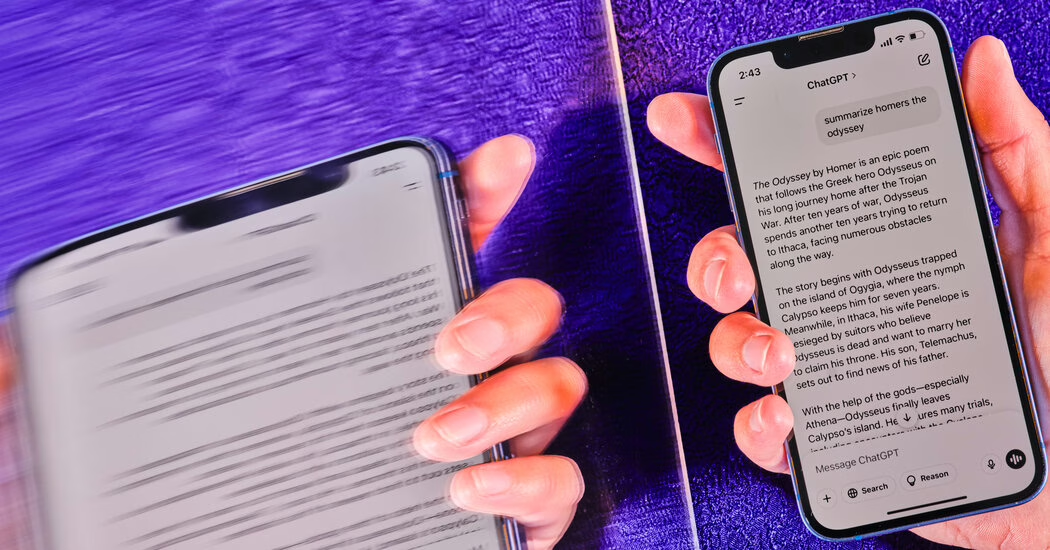

En septiembre, OpenAI presentó una nueva versión de ChatGPT diseñada para razonar a través de tareas que involucran matemáticas, ciencias y programación de computadoras. A diferencia de las versiones anteriores de ChatBot, esta nueva tecnología podría pasar tiempo «pensando» a través de problemas complejos antes de resolver una respuesta.

Pronto, la compañía dijo que su nueva tecnología de razonamiento superó los principales sistemas de la industria en una serie de pruebas que acompañan el progreso de la inteligencia artificial.

Ahora, otras compañías, como Google, Anthrope y Deepsek China, ofrecen tecnologías similares.

¿Pero puede la IA realmente razonar como un humano? ¿Qué significa esto para que una computadora piense? ¿Estos sistemas realmente se acercan a la verdadera inteligencia?

Aquí hay una guía.

El razonamiento solo significa que Chatbot pasa un tiempo adicional trabajando en un problema.

«El razonamiento es cuando el sistema hace un trabajo adicional después de la pregunta», dijo Dan Klein, profesor de informática en la Universidad de California, Berkeley, y Director de Tecnología de Scaled Cognition, una nueva empresa de IA.

Puede dividir un problema en pasos individuales o tratar de resolverlo a través del intento y el error.

El chatgpt original respondió las preguntas de inmediato. Los nuevos sistemas de razonamiento pueden funcionar con un problema durante varios segundos, o incluso minutos, antes de responder.

En algunos casos, un sistema de razonamiento refinará su enfoque a una pregunta, tratando repetidamente de mejorar el método que ha elegido. Otras veces, puede probar varias formas diferentes de abordar un problema antes de resolver uno de ellos. O puede regresar y verificar algunos trabajos que hizo unos segundos antes, solo para ver si era correcto.

Básicamente, el sistema intenta lo que pueda para responder a su pregunta.

Esto es como un estudiante de primaria que lucha por encontrar una manera de resolver un problema de matemáticas y garabatear varias opciones diferentes en una hoja de papel.

Potencialmente puede razonar sobre cualquier cosa. Pero el razonamiento es más efectivo cuando hace preguntas que involucran matemáticas, ciencias y programación de computadoras.

Puede pedirle a los chatbots anteriores que le muestren cómo habían alcanzado una respuesta específica o para verificar su propio trabajo. Como el ChatGPT original había aprendido del texto en Internet, donde las personas mostraron cómo habían recibido una respuesta o verificar su propio trabajo, esto también podría hacer este tipo de autorreflexión.

Pero un sistema de razonamiento va más allá. Puedes hacer ese tipo de cosas sin que te lo preguntaran. Y eso puede hacerlos de manera más extensa y compleja.

Las empresas llaman a esto un sistema de razonamiento porque parece funcionar más como una persona que piensa en un problema difícil.

Empresas como OpenAI creen que esta es la mejor manera de mejorar sus chatbots.

Durante años, estas compañías han confiado en un concepto simple: cuantos más datos de Internet bombearon en sus chatbots, mejor se realizarán los sistemas.

Pero en 2024, usaron casi todo el texto en Internet.

Esto significaba que necesitaban una nueva forma de mejorar sus chatbots. Luego comenzaron a construir sistemas de razonamiento.

El año pasado, compañías como OpenAI comenzaron a mantenerse fuertemente en una técnica llamada Reffory Learning.

A través de este proceso, que puede extenderse a lo largo de los meses, un sistema de IA puede aprender comportamiento a través de intentos y errores extensos. Al trabajar con miles de problemas de matemáticas, por ejemplo, puede aprender qué métodos conducen a la respuesta correcta y cuál no.

Los investigadores diseñaron mecanismos de retroalimentación complejos que muestran el sistema cuando hizo algo bien y cuando hizo algo mal.

«Es un poco como entrenar a un perro», dijo Jerry Tworek, un investigador de Operai. «Si el sistema funciona bien, le das una galleta. Si no te va bien, dices ‘perros malos'».

(El New York Times demandó a Openai y a su socio Microsoft en diciembre por la violación de los derechos de autor del contenido de noticias relacionados con los sistemas de IA).

Funciona muy bien en ciertas áreas, como la programación de matemáticas, la ciencia y las computadoras. Estas son áreas donde las empresas pueden definir claramente el buen comportamiento y el mal. Los problemas matemáticos tienen respuestas definitivas.

El aprendizaje de refuerzo no funciona tan bien en áreas como la escritura creativa, la filosofía y la ética, donde la distinción entre el bien y el mal es más difícil. Los investigadores dicen que este proceso generalmente puede mejorar el rendimiento de un sistema de IA, incluso cuando responde preguntas fuera de las matemáticas y las ciencias.

«Poco a poco aprende qué patrones de razonamiento lo lleva en la dirección correcta y cuáles no», dijo Jared Kaplan, director de ciencias de Anthrope.

No. El aprendizaje de refuerzo es el método que las empresas usan para crear sistemas de razonamiento. Es la fase de entrenamiento la que permite que los chatbots razonen.

Absolutamente. Todo lo que hace un chatbot se basa en probabilidades. Él elige una manera más similar a los datos que ha aprendido: si estos datos provienen de Internet o se generaron a través del aprendizaje de refuerzo. A veces eliges una opción incorrecta o no tiene sentido.

Los expertos en IA se dividen en este problema. Estos métodos aún son relativamente nuevos y los investigadores aún están tratando de comprender sus límites. En el campo de la IA, los nuevos métodos generalmente progresan muy rápidamente al principio, antes de disminuir la velocidad.

MundoDaily – #Como #chatbots #como #chatgpt #profundos #steek #motive

Publish: 2025-03-26 18:41:00